Исследователи упростили процесс создания дипфейков

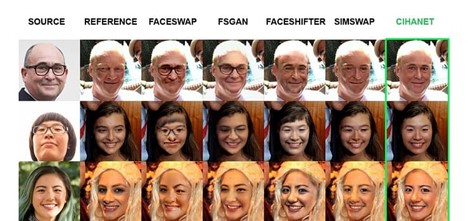

Группа китайских и американских исследователей разработала алгоритм создания дипфейков CihaNet, устраняющий проблему маскировки краев при смене лиц. Это делает подделку более реалистичной.

По словам разработчиков, для CihaNet не требуются большие и исчерпывающие наборы данных, а обучение происходит в считанные дни вместо недель.

Например, в эксперименте исследователи использовали два популярных датасета с изображениями знаменитостей и один графический процессор NVIDIA Tesla P40. Такая конфигурация позволила обучить нейросеть реалистично подменивать лица всего за три дня.

Новый подход устраняет необходимость грубо «вставлять» трансплантированную личность в целевое видео, что часто приводит к характерным артефактам, которые появляются на границах двух лиц. Это позволило избежать дальнейшей постобработки видео, что существенно экономит время и ресурсы, говорится в работе.

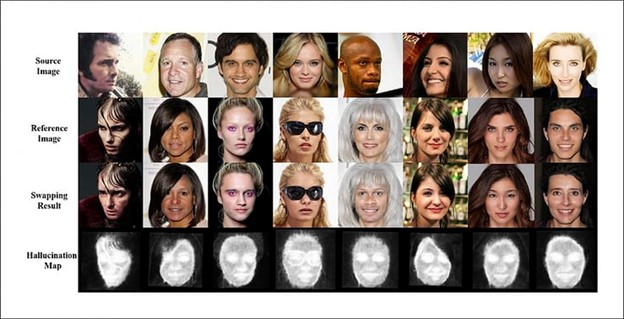

Для достижения таких результатов исследователи использовали «карту галлюцинаций». По их словам, это позволяет алгоритму определять контекст намного эффективнее и смешивать лица на более глубоком уровне.

Представленная модель, в отличие от метода жесткого наложения масок, может осуществлять подмену лица между двумя фотографиями, сделанными с разных ракурсов.

Исследователи не сообщили о планах выпуска инструмента в публичный доступ.

Напомним, в октябре разработчик программного обеспечения Adobe представил инструменты для оживления фотографий и создания дипфейков.

В сентябре ученые рассказали, как отличить поддельные фото от реальных.

В апреле генеральный директор компании Pinscreen заявил, что количество дипфейков в интернете удваивается раз в шесть месяцев.

Подписывайтесь на новости ForkLog в Telegram: ForkLog AI — все новости из мира ИИ!

Рассылки ForkLog: держите руку на пульсе биткоин-индустрии!