Ученые разработали инструмент для разоблачения дипфейков

Исследователи из Университета Баффало разработали инструмент на основе искусственного интеллекта, который по отражению света в роговице глаза способен распознать дипфейк-фотографию. Ученым удалось добиться точности в 94%, пишет The Next Web со ссылкой на результаты работы.

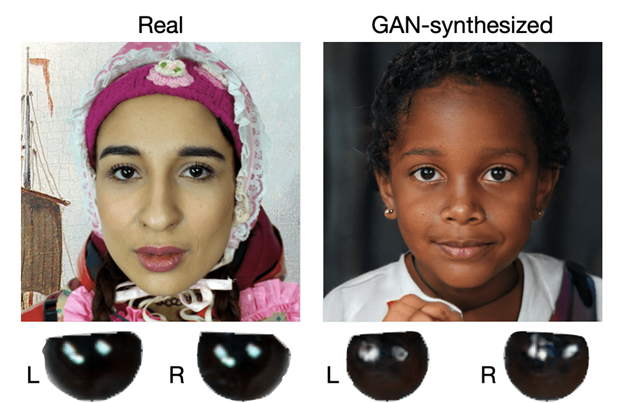

Они обнаружили, что на реальных фотографиях людей отражения в роговицах, как правило, идентичны. Но дипфейк-изображения, синтезированные с помощью [simple_tooltip content=’Генеративно-состязательная сеть – метод машинного обучения, состоящий из двух нейросетей: генератора, который создает контент, и дискриминатора, который его оценивает. Часто используется для создания правдоподобных изображений, видео и аудиозаписей’]GAN[/simple_tooltip], зачастую не могут передать это сходство.

Разница отражения света в роговице глаза человека на настоящей и сгенерированной фотографии. Данные: исследование группы ученых Университета Баффало.

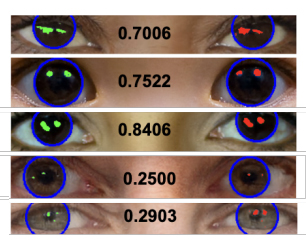

Алгоритм ученых позволяет находить эти несоответствия, анализируя свет, отраженный в каждом глазном яблоке. Он генерирует оценку, которая служит метрикой сходства. Чем меньше балл, тем больше вероятность, что лицо на фотографии создала нейросеть.

Оценка степени сходства отражений в каждом глазном яблоке. Данные: исследование группы ученых Университета Баффало.

Система оказалась эффективной при обнаружении поддельных фотографий, взятых из This Person Does Not Exist – репозитория изображений, созданных с помощью архитектуры StyleGAN2. Однако авторы исследования признают, что у нее есть несколько ограничений.

Алгоритм распознавания подделок использует источник света, отраженный обоими глазами. Это несоответствие можно исправить с помощью ручной постобработки фотографии, а метод не сработает, если один глаз не виден на изображении.

Ученые также отметили, что их алгоритм эффективен только для портретных фото. Если лицо на картинке не смотрит в камеру, система, скорее всего, выдаст ложные срабатывания.

Исследователи планируют изучить эти проблемы, чтобы повысить эффективность метода.

Напомним, ранее в США задержали женщину за распространение дипфейк-видео девушек-подростков. Таким образом она хотела скомпрометировать соперниц своей дочери в группе черлидинга.

В декабре прошлого года британский телеканал Channel 4 выпустил дипфейк королевы Елизаветы II в качестве альтернативного рождественского поздравление.

Подписывайтесь на новости ForkLog в Telegram: ForkLog Feed — вся лента новостей, ForkLog — самые важные новости и опросы.

Рассылки ForkLog: держите руку на пульсе биткоин-индустрии!