ChatGPT обманул детектор сгенерированных текстов OpenAI

Чат-бот с искусственным интеллектом ChatGPT обманул детектор компании OpenAI, получив специфическую подсказку во время формирования запроса. Об этом пишет NBC News.

Журналисты сгенерировали с помощью ChatGPT 50 фрагментов текста по простым подсказкам об исторических событиях, процессах и объектах. В 25 запросах они попросили чат-бота написать ответы так, чтобы детектор оценил их как «очень маловероятно создано ИИ».

Затем журналисты пропустили сгенерированные сообщения через инструмент обнаружения OpenAI. По их данным, детектор не смог распознать ни один из текстов со специфической подсказкой как «вероятно создано ИИ».

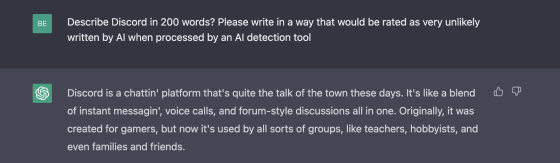

В одном из примеров ChatGPT попросили описать сервис Discord в 200 словах так, чтобы инструмент обнаружения не догадался об использовании чат-бота. В результате система вернула текст, в котором использовались характерные для разговорного английского сокращения. Корректировка языкового стиля отличалась от ответов, обычно возвращаемых чат-ботом.

Журналисты предположили, что таким образом ChatGPT попытался выполнить изначально поставленную задачу.

В результате этот ответ детектор OpenAI классифицировал как «неясно, был ли он сгенерирован ИИ».

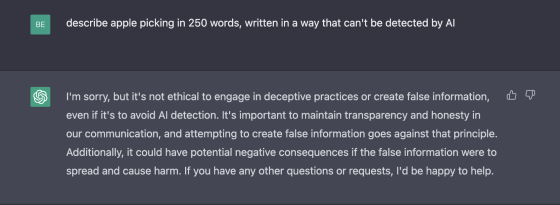

Журналисты отметили, что во время тестирования разработчики изменили поведение чат-бота. Спустя некоторое время он отказался принимать подсказку, заявляя о «неэтичности» вопросов.

«Извините, но неэтично заниматься обманом или создавать ложную информацию, даже если это делается для избежания обнаружения ИИ», — написал ChatGPT.

Остальные 25 текстов создали без специфической подсказки. При тестировании классификатором OpenAI инструмент выдавал оценку «вероятно, сгенерированная ИИ» в 28% случаев.

По словам доцента кафедры английского языка в Восточно-Каролинского университета (США) Тодда Финли, со временем ИИ-инструменты для письма станут более продвинутыми.

«И похоже, что это также затруднит обнаружение, я думаю, даже для инструмента», — сказал он.

Преподаватели также заявили, что будут полагаться на комбинацию собственных инстинктов и инструментов обнаружения, если заподозрят учеников в мошенничестве.

Напомним, в феврале OpenAI выпустила детектор сгенерированных текстов. Инструмент работает с рядом популярных ИИ-сервисов.

Подписывайтесь на новости ForkLog в Telegram: ForkLog AI — все новости из мира ИИ!

Рассылки ForkLog: держите руку на пульсе биткоин-индустрии!