Темная эра ИИ: почему этика искусственного интеллекта важна

За последние шесть лет технология искусственного интеллекта набрала огромную популярность. Разработки в этой сфере могут произвести революцию и изменить нашу повседневную жизнь.

На фоне ажиотажа вокруг ИИ также высказываются опасения касательно этических последствий его развития. Дискуссию подогрел рост популярности сервисов вроде ChatGPT или Stable Diffusion, способных генерировать правдоподобные тексты и изображения.

По мнению некоторых экспертов, риски не ограничиваются потенциальными дезинформационными атаками и выходят за рамки генеративных сервисов, распространяясь чуть ли не на все сферы деятельности человека.

ForkLog рассмотрел основные концепции этичного ИИ и постарался разобраться, действительно ли это важно для разработки безопасного искусственного интеллекта.

- Дебаты об этике искусственного интеллекта продолжаются с момента появления технологии.

- Алгоритмы, взаимодействующие с людьми, необходимо проверять на наличие рисков в соответствии с общепринятыми нормами морали.

- Искусственный интеллект не нужно делать похожим на человеческий.

- Ученые, техгиганты и правительства сходятся в основных принципах этичного ИИ.

Определение этики ИИ и история термина

Сама по себе этика — философская дисциплина, исследующая нравственность и мораль. Другими словам, она объясняет, что такое хорошо, а что такое плохо.

Этика искусственного интеллекта, в свою очередь, является совокупностью принципов ответственного ИИ — как он должен поступать, а как не должен. Эти принципы часто подразумевают безопасность, справедливость и ориентированность на человека.

Одними из первых тему «машинной морали» подняли писатели, работающие в жанре научной фантастики. В своих произведениях они рассуждали о поведении роботов, их разуме, чувствах и взаимодействии с человеком. Это течение получило название «робоэтика».

Популяризатором явления принято считать Айзека Азимова — автора рассказа «Хоровод». В нем писатель впервые сформулировал «Три закона робототехники». Позже в романе «Роботы и империя» Азимов дополнил список нулевым правилом. Они звучат примерно так:

- Робот не может своим действием причинить вред человечеству, либо же в результате бездействия допустить, чтобы человечеству был нанесен вред.

- Робот не может своим действием причинить вред человеку, либо же в результате бездействия допустить, чтобы человеку был нанесен вред.

- Робот должен подчиняться приказам человека за исключением случаев, когда эти приказы противоречат Первому закону.

- Робот должен защищать свою безопасность до тех пор, пока она не противоречит Первому или Второму закону.

Законы Азимова обрели популярность и вышли далеко за пределы его литературных произведений. Их до сих пор обсуждают писатели, философы, инженеры и политики.

По мнению ряда критиков, подобные нормы тяжело реализовать на практике. Фантаст Роберт Сойер однажды заявил, что бизнес не заинтересован в развитии коренных мер безопасности.

Однако трансгуманист Ханс Моравек имеет противоположное мнение. По его словам, корпорации, использующие роботов на производстве, могут использовать «сложный аналог» этих законов для управления техническим процессом.

Сформулированные Азимовым правила использовали и правительственные структуры. В 2007 году власти Южной Кореи начали разработку «Устава этических норм для роботов». Основные положения документа напоминают изложенные писателем постулаты.

В связи с применением роботов в военной сфере проблема стала более актуальной. В 2021 году ООН впервые зафиксировала убийство человека автономным устройством. Дрон с искусственным интеллектом самостоятельно определил цель, выследил ее и принял решение о ликвидации.

После популяризации генеративных алгоритмов вроде GPT или DALL-E дискуссии об этике искусственного интеллекта расширились. Правительства стран обсуждают потенциальные риски и рассказывают о планах регулирования технологии, а техгиганты активно развивают внутренние команды для создания безопасного ИИ.

«Проблема вагонетки»

Развитие технологий, прямо влияющих на жизни людей, порождают целый ряд этических и моральных дилемм. Наиболее ярко их можно описать на примере беспилотных автомобилей: как должен поступить робокар в экстренной ситуации? Поставить под угрозу жизнь пассажира или пешехода?

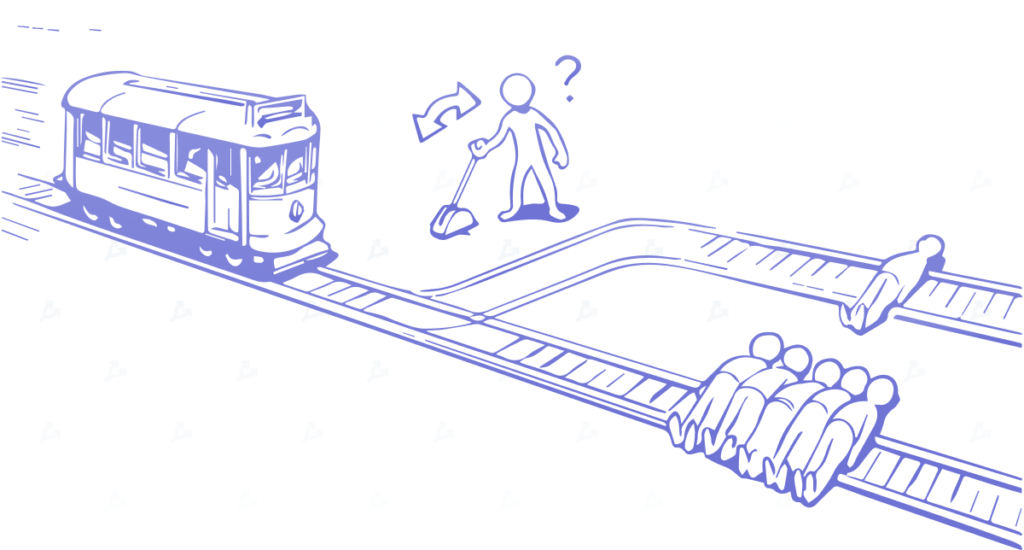

Эту дилемму хорошо иллюстрирует мысленный эксперимент «проблема вагонетки», который в 1967 году сформировала английская философиня Филиппа Фут. Общий смысл задачи звучит следующим образом:

«Вагонетка потеряла управление и мчит по железнодорожной колее. Впереди на путях привязаны и обездвижены пять человек. Вы стоите на определенном расстоянии от места событий, возле стрелки. Если вы переведете стрелку, вагонетка промчится по соседней колее, однако там привязан один человек.

У вас нет возможности повлиять на ситуацию. Есть только два варианта: ничего не делать, и вагонетка убьет пять человек, или перевести стрелку и пожертвовать одной жизнью. Какой вариант правильный?»

Большинство моральных принципов можно переформатировать в похожие задачи и провести ряд экспериментов. В реальной жизни может оказаться намного больше вариантов, а последствия — менее трагичными. Однако сделанный ИИ-системой выбор так или иначе будет влиять на жизни, и исключать все риски нельзя.

ИИ не должен учиться у людей

Несмотря на то, что моральные и этические принципы формирует человек, ИИ не должен походить на людей, поскольку в алгоритм могут проникнуть свойственные обществу предвзятости.

Это хорошо иллюстрирует технология распознавания лиц. Для создания релевантных систем собирают большой набор данных с изображением людей. Часто за процессом стоят автоматизированные боты, которые не учитывают разнообразие выборки и контекст. В результате датасет изначально может оказаться предвзятым.

Следующий этап разработки — построение модели и тренировка. На этой стадии также могут проникнуть предубеждения и искажения, в том числе из-за проблемы «черного ящика». Инженеры попросту не знают, почему алгоритм выносит то или иное решение.

Риски предвзятости существуют и на уровне интерпретации. Однако на этом этапе уже большую роль играет человек. Например, алгоритм обучили на определенной выборке людей и получили конкретные результаты. Затем применили систему к совершенно другой группе — данные кардинально изменились.

В 2021 году нидерландские активисты доказали наличие искажений в системе распределения социальной помощи. По их словам, ее использование нарушало права человека. В результате муниципальные власти отказались от эксплуатации ПО.

О проблеме с переносом данных сообщают и сами разработчики. В марте 2023 года группа исследователей разработала алгоритм, прогнозирующий риск появления рака поджелудочной железы. Для обучения системы исследователи в основном использовали медицинские записи пациентов датских клиник.

Ученые предупредили, что точность алгоритма при проецировании на пациентов из США сильно снижается. Из-за этого алгоритм следуем переучить на данных американцев.

Популярные принципы этичного ИИ

Исследовательские группы, правозащитники, техгиганты и правительства предлагают разные подходы, однако все они имеют ряд сходств. Рассмотрим наиболее популярные мнения.

Справедливость и недискриминация

Системы искусственного интеллекта необходимо разрабатывать таким образом, чтобы свести к минимуму дискриминацию по признаку расы, пола, религии или других защищенных характеристик. Предубеждения в алгоритмах могут укрепить существующее неравенство и нанести вред определенным группам.

Например, системы распознавания лиц показали предвзятость в своей точности с более высоким уровнем ошибок для определенных расовых и гендерных групп. В 2019 году темнокожий житель штата Нью-Джерси (США) провел 10 суток в тюрьме из-за ошибки алгоритма. Подобные случаи происходили и в других городах, за что полиция столкнулась с волной критики из-за использования необъективных технологий.

Этические методы ИИ могут помочь выявить и смягчить такие предубеждения, способствуя справедливости при принятии решений.

Прозрачность и объяснимость

Прозрачность и объяснимость имеют решающее значение для укрепления доверия к ИИ. Системы необходимо создавать таким образом, чтобы их процессы и результаты принятия решений были понятны всем заинтересованным сторонам.

Разработчики генеративных ИИ-систем рассматривают возможность внедрения водяных знаков для маркирования контента, созданного алгоритмами. Они считают, что это повысит осведомленность пользователей и предотвратит распространение дезинформации.

Другим примером прозрачного использования ИИ является закон штата Иллинойс (США) о конфиденциальности биометрических данных. Документ запрещает предприятиям использовать технологии вроде распознавания лиц без явного уведомления пользователей.

В рамках закона компании вроде Google и Clearview AI уже столкнулись с многомиллионными штрафами или ограничениями в деятельности.

Сторонники данного подхода считают, что прозрачность способствует ответственному принятию решений и предотвращает неправомерное использование систем ИИ.

Подотчетность и ответственность

Заинтересованные стороны должны нести ответственность за разработку и использование систем ИИ, а также их потенциальное влияние на людей, общество и окружающую среду. Им необходимо обеспечить полезное использование технологии.

Это включает в себя рассмотрение этических последствий от внедрения ИИ-систем и активное участие в принятии решений на протяжении всего процесса разработки и развертывания.

Конфиденциальность и защита данных

Системы искусственного интеллекта часто используют персональную информацию, и обеспечение конфиденциальности является важным фактором. Этические методы ИИ включают получение согласия на сбор и использование данных. Также необходимо обеспечить контроль над тем, как поставщики услуг распоряжаются сведениями о пользователях.

Это гарантирует соблюдение прав на неприкосновенность частной жизни и защиту личной информации, считают эксперты.

По этой причине в конце марта 2023 года ChatGPT заблокировали в Италии. Местный регулятор обвинил разработчиков в незаконном сборе личных данных, что вынудило OpenAI ввести более прозрачные методы работы.

Вероятно, чтобы не столкнуться с такими же проблемами, глобальное развертывание чат-бота Bard компании Google обошло стороной не только ЕС, где действует GDPR, но и весь европейский континент.

Человекоцентричность

Этичный ИИ ставит во главу угла человекоцентричность. Это значит, что алгоритмы необходимо разрабатывать для расширения возможностей людей, а не на замену им.

Принцип включает рассмотрение потенциального влияния ИИ на рабочие места, социальную динамику и общее благополучие, а также обеспечение соответствия технологии человеческим ценностям.

Бизнес и закон

Соблюдение этических норм ИИ — это не только ответственное поведение. Они также необходимы для извлечения коммерческой выгоды. Вопросы этики могут представлять собой бизнес-риски, такие как неудачи в производстве продукции, юридические проблемы или репутационный ущерб бренда.

В теории использование алгоритмов слежки за доставщиками в Amazon может обезопасить водителей. Однако работники оказались недовольны злоупотреблением наблюдением, что вызвало шумиху в СМИ, а топ-менеджменту пришлось оправдываться.

Тем временем Гильдия сценаристов объявила крупнейшую за 15 лет забастовку, частично связанную с распространением генеративного ИИ. Авторы требуют запретить или существенно ограничить использование технологии в писательском деле и пересмотреть зарплаты.

Чем закончится текущий протест неизвестно. Однако стодневная забастовка в 2007-2008 годах обошлась бюджету Калифорнии в $2,1 млрд.

Одной из причин подобных событий может быть бесконтрольное развитие и использование алгоритмов. Тем не менее отдельные страны и даже города применяют свои собственные подходы к моральной стороне вопроса. Это означает, что компаниям необходимо знать о правилах ИИ на уровне юрисдикции, в пределах которой они осуществляют деятельность.

Яркими примерами являются положение «Право на объяснение» в GDPR и соответствующие разделы Калифорнийского закона о конфиденциальности потребителей.

Некоторые американские города на местном уровне приняли решения об ограничении использования алгоритмов. В ноябре 2022 года власти Нью-Йорка запретили предвзятые ИИ-системы для рекрутинга. До этого в городе вступило в силу постановление, обязывающее частные заведения обеспечить конфиденциальность биометрических данных посетителей.

Одним из крупнейших регуляторных инициатив в области ИИ является готовящийся к принятию Закон об ИИ в Евросоюзе.

***

Этичный ИИ имеет важное значение в разработке и внедрении технологий. Он может обеспечить справедливость, прозрачность, конфиденциальность и ориентированность на человека для благоприятного развития общества.

Помимо этого, применение руководящих принципов способно обеспечить компаниям коммерческую выгоду, в том числе предотвращая обеспокоенность сотрудников, потребителей и других заинтересованных лиц.

Споры и дебаты вокруг ИИ способны перерасти в конструктивный диалог. Чрезмерное регулирование может помешать развитию технологии и погубить не раскрывшийся потенциал. Поэтому сейчас существует необходимость в поиске выверенных решений в области этичного использования ИИ, которое удовлетворит максимально возможное количество людей.

Рассылки ForkLog: держите руку на пульсе биткоин-индустрии!